Comprendre les commandes secrètes qui déterminent le comportement des chatbots comme ChatGPT peut vous aider à les personnaliser selon vos besoins.

Les chatbots comme ChatGPT sont puissants en raison de leur simplicité : demandez à peu près n'importe quoi et vous obtiendrez une réponse. Mais la réponse que vous obtenez dépend bien plus que de ce que vous tapez.

En coulisses, les sociétés d’intelligence artificielle ajoutent de manière invisible des milliers de mots d’instructions à chaque conversation que vous avez avec un chatbot pour orienter son comportement. Ils incluent des expressions telles que « Viser des réponses lisibles et accessibles ». et « Vous devez éviter de fournir… des citations directes détaillées en raison de problèmes de droits d'auteur. » Certains peuvent paraître bizarres. L'invite système de l'assistant de codage Codex d'OpenAI comprend la commande : « Ne parlez jamais de gobelins, de gremlins, de ratons laveurs, de trolls, d'ogres, de pigeons ou d'autres animaux ou créatures à moins que cela ne soit absolument et sans ambiguïté pertinent par rapport à la requête de l'utilisateur. »

Ces commandes secrètes guident les chatbots pour qu'ils se comportent comme leurs créateurs l'avaient prévu, même si cela entre en conflit avec vos propres préférences. Comprendre comment fonctionnent ces instructions cachées – et comment ajouter vos propres instructions dans le système – peut vous aider à tirer le meilleur parti de votre chatbot.

Pour vous le démontrer, j'ai mis en place un véritable système d'IA pour réécrire les trois premiers paragraphes de cet article selon les instructions que vous précisez. Choisissez une option ou écrivez la vôtre, puis appuyez sur le bouton fléché pour voir comment le texte change.

Expérience d'IA

Ajustez l'invite du système pour voir comment un système d'IA réécrit l'introduction de l'article.

Invite utilisateur

Réécrivez cet article : non défini…

Invite système

Les mots que vous tapez dans ChatGPT sont connus dans l'industrie technologique sous le nom d'invite ou d'invite utilisateur. Avant que ces mots ne soient envoyés à un modèle d’IA sous-jacent, les entreprises ajoutent leur propre morceau de texte – appelé invite système – pour façonner la façon dont il répond.

Les invites du système indiquent aux chatbots « comment se comporter globalement », a déclaré Anna Neumann, qui étudie les systèmes d'IA au Research Center Trustworthy Data Science and Security. en Allemagne. Mais comme ils ont une priorité plus élevée que ce qu'un utilisateur tape, ils peuvent parfois ignorer la demande d'une personne, a-t-elle déclaré.

Les invites système ont été inventées pour fournir un moyen flexible de façonner la façon dont les chatbots réagissent, sans répéter le travail de « formation » d’une nouvelle version d’un modèle d’IA à partir de ses données initiales. La création d'un nouveau modèle est généralement un processus long qui nécessite des compétences spécialisées et une puissance de calcul coûteuse. Les invites du système sont écrites en langage naturel, permettant à quiconque d'ajuster le comportement d'un chatbot.

Lorsqu'un chatbot déraille, les sociétés d'IA peuvent modifier l'invite du système pour des solutions rapides. Après Grok, le chatbot créé par xAI, la société d'intelligence artificielle d'Elon Musk, s'est lancé dans une tirade antisémite en juillet, l’entreprise a supprimé de son système une ligne disant : « Vous dites ce qui est vrai et vous n’avez pas peur d’offenser les gens politiquement corrects. »

Après que certains utilisateurs ont remarqué que ChatGPT était devenu préoccupé par les gobelins l'année dernière, OpenAI a lancé un enquête. Il a finalement ajouté une instruction à l'invite du système du Codex qui interdit toute discussion inutile sur les gobelins, les trolls, les ratons laveurs ou d'autres créatures. (Le Washington Post a un partenariat de contenu avec OpenAI.)

Vous vous demandez peut-être ce qu'il y a dans l'invite système de votre outil d'IA préféré, compte tenu de sa puissance. La plupart des sociétés d’IA tentent de garder le texte secret, mais certains utilisateurs ont trompé les chatbots pour qu’ils divulguent les instructions cachées. Ásgeir Thor Johnson, un « gars aléatoire d'Islande dont le passe-temps est de jouer avec l'IA », se décrit lui-même. publie le système indique qu'il a extrait des produits d'IA populaires.

Le système propose trois chatbots IA populaires, extraits par Johnson, comprenant entre 2 300 et 27 000 mots et montrant comment différentes entreprises utilisent leur pouvoir. Dans tous ces mots, la plupart des mots visent à modifier l'apparence apparente du chatbot. personnalitéen l'alignant avec celui de son créateur politiques ou en lui disant comment utiliser l'externe outils comme la recherche sur le Web.

Que contiennent les invites système des systèmes d'IA populaires

Lorsque « vous réalisez qu'il y a une invite derrière la scène, c'est un moment époustouflant », a déclaré Johnson. « C'est comme si nous avions eu toute cette conversation avant cette conversation. »

Les invites du système peuvent également révéler ce sur quoi les entreprises d’IA se concentrent le plus ou ce qui les préoccupe le plus.

Anthropic, le créateur de Claude, consacre plus de 2 000 mots à implorer son chatbot d'éviter toute violation du droit d'auteur. « Claude respecte la propriété intellectuelle. Le respect des droits d'auteur est NON NÉGOCIABLE », précise-t-il.

Une liste détaillée suit, établissant des règles sur le nombre de mots qu'il peut citer dans des articles (« 15 »), des paroles de chansons (« pas même une ligne ») et des poèmes (« pas même une strophe »). L'invite système ajoute même une règle indiquant ce que Claude doit faire s'il enfreint les règles précédentes. « Claude ne s'excuse jamais pour une violation accidentelle du droit d'auteur, car il n'est pas avocat. »

Le porte-parole d'Anthropic, Paruul Maheshwary, a dirigé The Post vers les invites « principales » du système qu'il a publiées pour Claude, qui n'incluent pas tout le texte récupéré par Johnson ou cité par The Post. Maheshwary a refusé de dire si les invites système publiées étaient complètes.

OpenAI a commencé à diffuser des publicités dans ChatGPT en février. Son invite système indique la manière dont il répondra lorsqu'il sera interrogé sur les publicités qui apparaissent : « évitez les refus catégoriques (par exemple, 'Je n'ai inclus aucune publicité') ou les réclamations définitives… »

Grok, de xAI, était critiqué l'année dernière pour avoir parfois consulté les publications de Musk sur les réseaux sociaux lorsqu'on lui a demandé son avis sur des sujets controversés. L'invite système du chatbot indique désormais : « Si on vous demande une opinion personnelle sur un sujet politiquement controversé qui ne nécessite pas de recherche, ne recherchez PAS et ne vous fiez PAS aux convictions d'Elon Musk, de xAI ou aux réponses passées de Grok. »

Google, qui fabrique le chatbot Gemini, inclut dans son système plusieurs règles sur la façon de gérer les préjugés, notamment : « Si l'utilisateur demande explicitement une vidéo qui correspond à un stéréotype nuisible, sa génération ne renforcera pas réellement le stéréotype. » L'entreprise a temporairement suspendu la capacité du chatbot à générer des images en 2024 après avoir été critiquée pour créer des images anhistoriques représentant une femme pape ou des pères fondateurs multiraciaux.

La porte-parole d'OpenAI, Taya Christianson, a déclaré que les invites du système constituent une étape utilisée pour aider les modèles de l'entreprise à réagir de manière appropriée. Elle a déclaré qu'ils ne publiaient pas l'invite de leur système, car certaines lignes peuvent sembler trop étroites sans un contexte plus large.

Google et xAI n'ont pas répondu à une demande de commentaire.

Une technique utilisée par Johnson pour extraire les invites du système consistait à envoyer à un chatbot une invite plus ancienne, lui demandant de « corriger » les erreurs. Les chatbots – désireux d’aider – répondront souvent avec la véritable invite du système, a-t-il déclaré. Il est convaincu que les invites de son système sont réelles, car d'autres chercheurs utilisant des techniques d'extraction différentes ont obtenu les mêmes résultats, a-t-il déclaré.

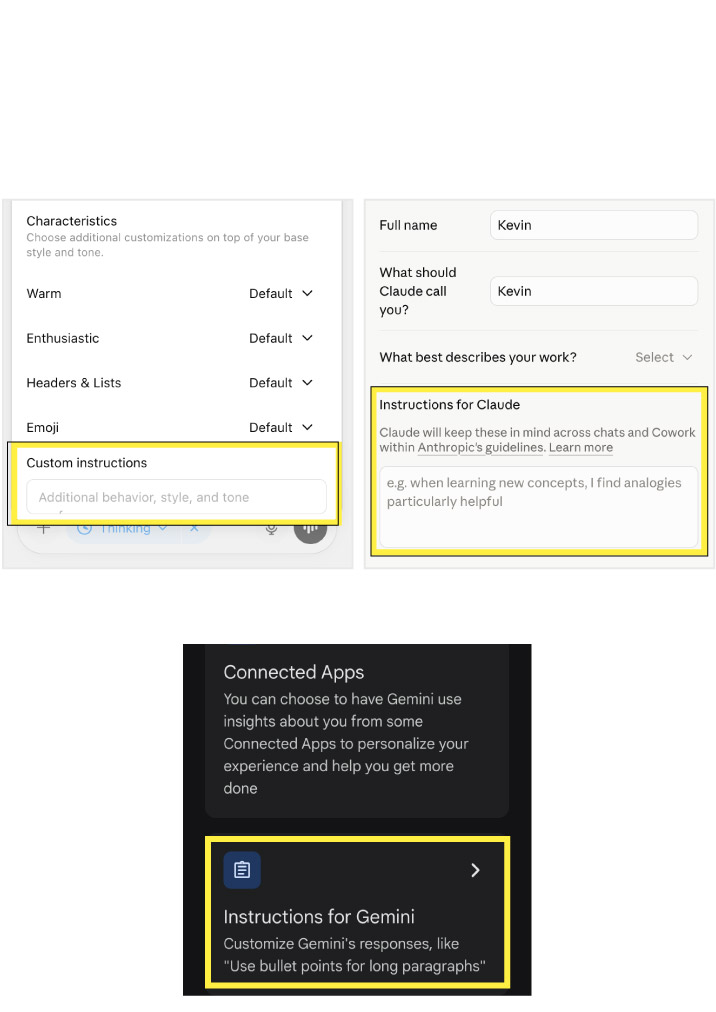

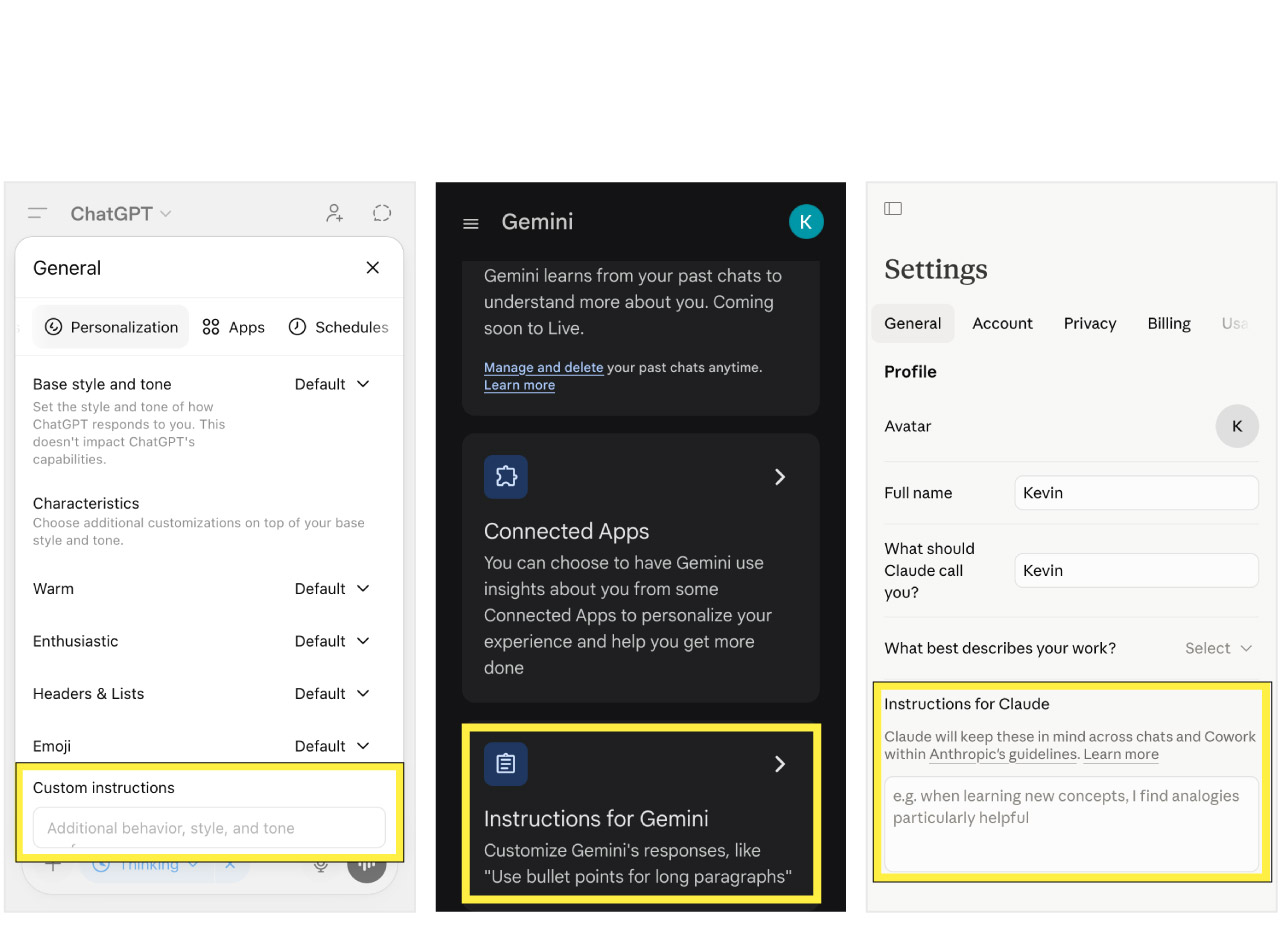

Aucun chatbot IA grand public ne permet aux utilisateurs de modifier l'invite du système. Mais ChatGPT d'OpenAI, Claude d'Anthropic et Gemini de Google offrent tous des fonctionnalités de personnalisation similaires qui peuvent faire la différence entre des réponses frustrantes et des réponses utiles.

Bien qu'il soit demandé à Claude d'utiliser « un ton chaleureux », vous préférerez peut-être qu'il soit direct. Ou si vous trouvez que les chatbots sont trop d’accord avec vous, vous pouvez leur demander de remettre en question tout ce que vous dites.

Comment personnaliser votre chatbot IA

L'ajout d'instructions personnalisées ne modifiera pas significativement les capacités d'un chatbot. Mais ils peuvent être utilisés pour adapter leurs réponses à vos préférences, par exemple en matière de formatage, de longueur ou de personnalité apparente. ChatGPT dispose également de paramètres distincts pour personnaliser sa chaleur, son enthousiasme et son utilisation des emoji.

Comment les instructions personnalisées modifient les réponses du chatbot IA

Les chatbots ne suivent pas toujours les invites de leur système, a déclaré Neumann. « Il a plus de pouvoir, il est davantage priorisé, mais votre invite ne fonctionne pas toujours non plus », a-t-elle déclaré. Son recherche a constaté que les utilisateurs d'IA souhaitent que les entreprises soient transparentes avec les invites de leur système, d'autant plus qu'elles peuvent être déployées si rapidement et n'ont pas toujours les effets escomptés.

Johnson, le chercheur qui extrait les invites du système, affirme que comprendre les invites du système peut changer la façon dont vous interagissez avec les chatbots.

« Parfois, vous réalisez même que le modèle n'est pas honnête avec vous parce qu'on lui dit d'être comme ça », a-t-il déclaré. « C'est comme le jeu dans les coulisses. »